Índice

Toggle¿Qué es un deepfake biométrico?

Un deepfake biométrico es una falsificación generada por IA que imita los datos biométricos de una persona (normalmente imágenes faciales o voz), a menudo con un realismo sorprendente. Mediante redes neuronales profundas, los atacantes pueden crear rostros o vídeos sintéticos que imitan fielmente la apariencia y las expresiones de un usuario real. Estas falsificaciones suponen una grave amenaza para los sistemas de reconocimiento facial y los procesos de verificación de identidad. Los ojos humanos e incluso los algoritmos estándar tienen dificultades para distinguir los deepfakes de alta calidad de las imágenes auténticas. En un estudio, las personas solo detectaron los vídeos deepfake en el 24,5 % de los casos.

Esto significa que el 75 % de los deepfakes pasaron desapercibidos, lo que pone de relieve la facilidad con la que pueden burlar defensas poco sofisticadas. Repercusión en el reconocimiento facial y la detección de vitalidad: el reconocimiento facial tradicional compara una selfie con una foto de identificación, dando por sentado que la selfie es real. Los deepfakes socavan este proceso al presentar una imagen o un vídeo en directo manipulados por IA del rostro de una persona. A diferencia de las falsificaciones tradicionales (por ejemplo, una foto impresa o una máscara), los deepfakes son dinámicos , el rostro falso puede parpadear, moverse e incluso responder a indicaciones, engañando a la detección básica de vitalidad. Los algoritmos de vitalidad están diseñados para garantizar que se captura el rostro de una persona viva (no una imagen fija o una reproducción), a menudo comprobando los movimientos naturales o la profundidad 3D. Sin embargo, las primeras generaciones de comprobaciones de vitalidad (como pedir a los usuarios que parpadeen o giren la cabeza) son fácilmente engañadas por la tecnología deepfake actual.

Por ejemplo, la IA ahora puede generar un vídeo de un rostro que parpadea y se mueve según las órdenes. Si un estafador introduce un vídeo deepfake a través de una aplicación de cámara virtual en un sistema de verificación, un control biométrico no preparado podría aceptarlo como «en vivo». Esto pone en grave riesgo la incorporación digital y la verificación de identidad a distancia. Los proveedores de tecnología financiera, los bancos e incluso los portales gubernamentales que se basan en la verificación mediante selfies han comprobado que los ataques deepfake pueden colarse, suplantando a las víctimas a pesar de las múltiples capas de seguridad.

El resultado puede ser la apertura de cuentas fraudulentas, transacciones no autorizadas o identidades falsas que superan los controles de «Conozca a su cliente» (KYC) y contra el blanqueo de capitales (AML).

Los deepfakes son cada vez más sofisticados, lo que aumenta el riesgo de fraude y manipulación de la identidad en entornos digitales. Descargue nuestra guía de 10 pasos para aprender a detectar amenazas de forma temprana y proteger su organización con prácticas recomendadas de eficacia probada.

Deepfake: del spoofing tradicional a los ataques impulsados por la IA

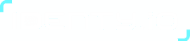

Falsificación biométrica frente a ataques basados en deepfakes: En el pasado, la principal preocupación eran los ataques de presentación que utilizaban accesorios físicos o medios grabados. Los estafadores podían mostrar la foto de una persona ante la cámara, llevar una máscara realista o reproducir un vídeo de la víctima. La detección de vida se introdujo para frustrar estos trucos, por ejemplo, detectando imágenes planas o exigiendo movimientos interactivos. Sin embargo, los deepfakes suben el listón.

No se trata solo de grabaciones robadas, sino de medios sintéticos generados por IA, que a menudo son capaces de emular movimientos faciales y comportamientos sutiles. Un deepfake bien elaborado puede parecer más convincente que una foto estática y, sin comprobaciones avanzadas, puede eludir los sistemas que solo buscan signos simples de vida. En esencia, los deepfakes son una extensión sofisticada del suplantación biométrica: en lugar de una falsificación burda (como una foto impresa), el atacante presenta una personalidad «viva» falsificada. Esto ha obligado a cambiar las estrategias de seguridad. Las soluciones estándar de soluciones de reconocimiento facial por sí solas no pueden distinguir de forma fiable un rostro real de un impostor generado por IA. Incluso muchos sistemas de detección de vida que no están actualizados no logran detectar deepfakes de alta calidad o máscaras 3D. La industria está aprendiendo que la autenticación biométrica tradicional es vulnerable a las falsificaciones impulsadas por la IA. Para abordar esto, los equipos de seguridad están recurriendo a defensas duales: autenticación biométrica + detección de deepfakes en tándem.

Falsificación tradicional frente a deepfake biométrico

Por qué la detección de actividad no es suficiente (por sí sola)

La detección de vitalidad sigue siendo fundamental, ya que comprueba que hay una persona viva delante de la cámara, y no solo un artefacto. Las técnicas van desde indicaciones activas (parpadear, sonreír, girar la cabeza) hasta análisis pasivos (aprendizaje automático que analiza la textura de la piel, los reflejos y la profundidad 3D a partir de un vídeo corto). La detección de vida puede detectar muchas presentaciones falsas. Por ejemplo, los sistemas certificados de detección de vida en 3D pueden detectar que un vídeo deepfake es, en última instancia, una proyección en 2D con una iluminación extraña, ya que una pantalla emite la luz de forma diferente a como la refleja un rostro real, lo que un buen sistema señalará.

Sin embargo, la detección de la vitalidad por sí sola puede no detectar todas las falsificaciones generadas por IA, especialmente a medida que mejoran los deepfakes. Por eso los expertos ahora hacen hincapié en combinar la detección de la vitalidad con algoritmos de detección de deepfakes. Los dos enfoques se complementan entre sí: la detección de la vitalidad confirma que hay un intento humano real, mientras que la detección de deepfakes analiza si ese rostro «humano» en sí mismo podría haber sido generado o manipulado por ordenador. La importancia de combinar enfoques: Las herramientas de detección de deepfakes utilizan la IA para examinar minuciosamente la información visual y auditiva en busca de signos reveladores de manipulación, como movimientos faciales poco naturales, sincronización labial inconsistente, distorsiones en la imagen o fallos en la textura y la iluminación. Estas son pistas de que un rostro podría haber sido alterado sintéticamente. Al superponer este análisis a las comprobaciones de vitalidad, una plataforma puede verificar tanto la presencia (ser humano vivo frente a artefacto) como la autenticidad (persona real frente a deepfake).

En entornos de alta seguridad, como la banca, las plataformas de seguridad biométrica con protección contra deepfakes se han vuelto esenciales. Los líderes del sector predicen que la detección de deepfakes pasará de ser una novedad a convertirse en una «higiene de seguridad» estándar en los próximos años. De hecho, los reguladores ya están avanzando en esta dirección. Las últimas directrices sobre identidad digital del NIST de EE. UU. incluyen explícitamente requisitos para defenderse de los deepfakes y otros ataques generados por la IA. Del mismo modo, los laboratorios externos ahora prueban la resistencia de los proveedores a los «ataques de inyección» (es decir, la resistencia a los vídeos deepfake inyectados o a las imágenes sintéticas) como parte de la certificación de los sistemas biométricos. Todo ello pone de relieve que una única capa de defensa ya no es suficiente. Solo un enfoque multicapa ,que combine la verificación de documentos, la comparación facial, la detección de vida y la detección de deepfakes, puede frustrar de forma fiable el fraude de identidad impulsado por la IA.

Descubra cómo Identy.io reforzó la seguridad móvil en el sector bancario con tecnología biométrica avanzada de huellas dactilares y una experiencia de usuario fluida.

Amenazas para las fintech, la banca y la incorporación de gobiernos

La incorporación digital en los servicios financieros y gubernamentales ha aumentado considerablemente, al igual que los intentos de fraude de identidad mediante deepfakes. Los bancos y prestamistas en línea, por ejemplo, utilizan la biometría de selfies para verificar rápidamente a los nuevos clientes. Pero los delincuentes están aprovechando esta comodidad. Las pruebas biométricas deepfake en el mundo real han puesto de manifiesto vulnerabilidades alarmantes. En un caso, una institución financiera indonesia descubrió más de 1100 intentos de deepfake para eludir su incorporación remota en 2024. Los estafadores obtuvieron datos de identificación robados y luego utilizaron la inteligencia artificial para generar nuevos selfies que coincidían con las identificaciones, suplantando eficazmente a las víctimas. Estos deepfakes engañaron al reconocimiento facial y las comprobaciones básicas de vitalidad del banco, lo que permitió que se aprobaran solicitudes de préstamos falsas. El plan solo se descubrió tras un análisis avanzado, pero puso de manifiesto que se podrían haber producido pérdidas de más de 138 millones de dólares si se hubieran explotado plenamente esas cuentas. Este ejemplo ilustra cómo un deepfake que elude el KYC no es una preocupación teórica , sino que está ocurriendo ahora mismo, a gran escala, en los mercados fintech.

Los organismos gubernamentales y reguladores están tomando nota. En Estados Unidos, la Red de Control de Delitos Financieros (FinCEN) del Tesoro emitió una alerta a finales de 2024 sobre los fraudes que utilizan deepfakes. La FinCEN advirtió de que los delincuentes podrían utilizar identificaciones sintéticas e incluso vídeos deepfake en tiempo real para eludir los controles de verificación en directo durante la identificación de los clientes. En una estafa destacada, los solicitantes intentaron abrir cuentas bancarias con fotos de pasaporte generadas por IA y alegaron problemas técnicos durante las verificaciones por vídeo en directo para encubrir los fallos del deepfake. Este tipo de incidentes son una señal de alarma para el cumplimiento de la normativa AML: si los bancos no pueden verificar de forma fiable las identidades reales, los delincuentes podrían crear cuentas para blanquear dinero o defraudar a los sistemas. Más allá de la banca, las agencias gubernamentales que prestan servicios digitales (desde portales fiscales hasta la inscripción en prestaciones sociales) se enfrentan a riesgos similares. Un deepfake podría permitir a alguien suplantar una identidad y acceder a los registros o derechos de otra persona, lo que socava la integridad de los programas de administración electrónica.

El ejemplo de la herramienta deepfake de YouTube: incluso las plataformas tecnológicas convencionales se enfrentan a esta amenaza. Recientemente, YouTube lanzó una herramienta de verificación biométrica para que los creadores detecten y eliminen los vídeos manipulados por IA que hacen un uso indebido de su imagen. Esta medida fue noticia por ser un arma de doble filo: es una respuesta al abuso de los deepfakes, pero suscitó preocupación, ya que la política de YouTube permite técnicamente que los datos biométricos recopilados (escaneos faciales de los creadores) se utilicen para el entrenamiento de la IA. Para los líderes del sector fintech y los gobiernos, la conclusión es clara: si un gigante como YouTube se ve obligado a implementar un mecanismo de detección de deepfakes, la amenaza está muy extendida. Y si los titulares sobre la «herramienta de verificación biométrica deepfake de YouTube» aparecen en las noticias, significa que los riesgos de los deepfakes han entrado en la conciencia pública. Desgraciadamente, las mismas herramientas accesibles que permiten a los creadores combatir los deepfakes pueden ser reutilizadas por los estafadores. Internet está plagado de tutoriales sobre cómo crear deepfakes convincentes; en el propio YouTube hay guías detalladas para generar intercambios de rostros utilizando software como DeepFaceLab. Esta democratización de la tecnología deepfake significa que incluso los atacantes con relativamente pocos conocimientos pueden intentar cometer fraudes de identidad mediante deepfakes. Las fintech y los bancos deben asumir que un porcentaje de sus intentos de incorporación serán falsificaciones asistidas por IA y prepararse en consecuencia.

Mejores prácticas contra el deepfake

Mejores prácticas para la detección biométrica de deepfakes en la seguridad fintech

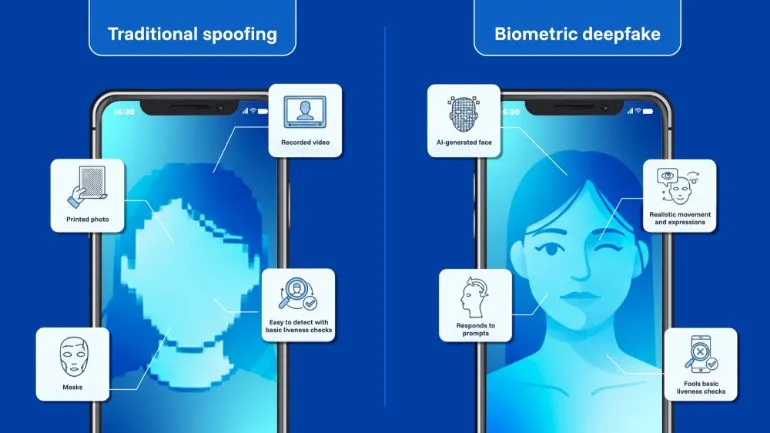

Para mantener la confianza digital y cumplir con las obligaciones de cumplimiento normativo, las organizaciones financieras y gubernamentales están adoptando las mejores prácticas para contrarrestar las amenazas de deepfakes. Estas son las estrategias clave que emplean las plataformas de seguridad biométrica modernas para la protección contra deepfakes:

Verificación de identidad multicapa

Las plataformas robustas combinan la autenticación de documentos, la comparación biométrica y la detección de suplantaciones en un solo flujo. Por ejemplo, un sistema avanzado de incorporación escaneará el documento de identidad del usuario en busca de signos de manipulación, comparará el rostro que aparece en el documento con una selfie en directo y realizará una detección de autenticidad y de deepfakes en esa selfie. Las múltiples comprobaciones crean capas de protección superpuestas, de modo que, aunque un deepfake consiga burlar una capa, otra podrá detectarlo. Este enfoque por capas se ajusta a las directrices de los reguladores de utilizar una verificación multifactorial basada en el riesgo (por ejemplo, algunas jurisdicciones exigen ahora una combinación de identificación con fotografía, verificación biométrica con verificación de vitalidad e incluso análisis de metadatos de teléfonos o IP para casos de alto riesgo).

Vitalidad pasiva para una mejor experiencia de usuario

La experiencia del usuario sigue siendo una prioridad, ya que un exceso de fricción puede ahuyentar a los clientes legítimos. Las últimas soluciones hacen hincapié en la detección pasiva de la vitalidad, que funciona en segundo plano sin necesidad de que los usuarios realicen movimientos incómodos. La IA analiza la señal de vídeo en busca de indicios de autenticidad (como la textura, los patrones de moiré o la profundidad 3D) en una fracción de segundo, normalmente cuando el usuario simplemente mira a la cámara. Este enfoque de seguridad pasivo, utilizado por plataformas como Identy, mantiene la fluidez del proceso de verificación al tiempo que garantiza que la persona es real. Cuando la detección pasiva de vida se combina con el escaneo de deepfakes, la seguridad es «invisible» para los usuarios honestos, que completan el proceso de registro en segundos, pero los intentos de suplantación de identidad se marcan discretamente para su revisión o rechazo. Lograr este equilibrio entre seguridad y comodidad es crucial para la adopción de la tecnología financiera, donde las tasas de abandono pueden perjudicar al negocio. Por lo tanto, una solución estratégica «confiará pero verificará» cada intento de registro de forma silenciosa, y solo actuará cuando algo parezca sospechoso.

Monitorización continua y análisis con IA

Los controles biométricos no deben detenerse tras la apertura de la cuenta. Los equipos de seguridad con visión de futuro implementan un monitoreo continuo del fraude que puede detectar el uso de deepfakes incluso después de la incorporación. Esto puede incluir inteligencia de dispositivos (para detectar el uso de emuladores o cámaras virtuales), análisis de comportamiento y monitoreo de transacciones vinculado a la reautenticación biométrica para acciones de alto riesgo. Por ejemplo, si una cuenta inicia repentinamente una transferencia grande a través de una transacción autorizada por video, el sistema puede solicitar una nueva verificación de vida + rostro y buscar signos de deepfake antes de la aprobación. Las plataformas modernas suelen integrar estas comprobaciones con bases de datos de fraude, de modo que si un rostro o dispositivo determinado se ha asociado a un intento de fraude deepfake conocido en otro lugar, puede incluirse automáticamente en una lista negra o someterse a una verificación reforzada. La colaboración a través del intercambio de información antifraude se está convirtiendo en una práctica recomendada, de modo que cuando un banco detecta a un atacante deepfake, se alerta a los demás para que estén atentos a las mismas señales.

Pruebas periódicas de resistencia a los deepfakes

Dada la rapidez con la que evoluciona la tecnología deepfake, los bancos y los proveedores deben evaluar periódicamente sus sistemas frente a las nuevas técnicas de ataque. Esto incluye la realización de pruebas biométricas deepfake en entornos controlados, esencialmente simulando el sistema con caras y voces falsas generadas para ver si alguna se cuela. Algunas instituciones se asocian con empresas de seguridad o participan en pruebas del sector (por ejemplo, iBeta Labs y evaluadores independientes ahora prueban los sistemas biométricos para comprobar su resistencia a los vídeos deepfake como parte de la certificación). Mediante pruebas y ajustes proactivos, las organizaciones pueden corregir las vulnerabilidades antes de que los delincuentes las descubran. Además, mantenerse al día con las últimas normas (como la ISO/IEC 30107 para la detección de ataques de presentación biométrica y sus nuevas extensiones que abordan los ataques de IA) garantiza que la plataforma cumpla con los más altos estándares de seguridad.

Formación de usuarios y personal

Por último, una medida suave pero importante es concienciar sobre los deepfakes. El personal de cumplimiento de primera línea debe recibir formación para detectar signos de posible uso de deepfakes en las revisiones manuales (por ejemplo, si el vídeo de un solicitante tiene movimientos oculares poco naturales o si el vídeo de un entrevistado se retrasa de forma extraña y no está sincronizado con el audio). También se puede educar a los clientes sobre la verificación de las comunicaciones; por ejemplo, un banco podría advertir que nunca pedirá que se realicen determinadas acciones a través de una videollamada, de modo que el cliente pueda cuestionar una situación en la que un «empleado del banco» en el vídeo parece real pero le presiona para que realice una transacción inusual (una situación que se ha dado con deepfakes de fraude de CEO). Crear una cultura de «escepticismo digital» en torno a las solicitudes biométricas inesperadas puede añadir una capa adicional de defensa contra la ingeniería social que emplea deepfakes.

Proteger la identidad digital en la era del deepfake

Los deepfakes representan una amenaza emergente para la seguridad digital, especialmente en sectores de alta confianza como las finanzas y el gobierno. Para los directores de marketing, esta amenaza se traduce en una posible erosión de la confianza de los clientes: si los usuarios son víctimas de un fraude debido a un deepfake, la reputación de la marca en materia de seguridad puede desplomarse. Para los directores técnicos y los responsables de seguridad, los deepfakes son una llamada a la acción para reforzar los sistemas ahora, en lugar de más adelante, porque el coste de la inacción se mide en pérdidas por fraude, sanciones por incumplimiento y daño a la confianza pública. La solución estratégica es invertir en plataformas de seguridad biométrica avanzadas que ofrezcan protección contra los deepfakes por diseño. Plataformas como Identy ejemplifican este enfoque al combinar la detección biométrica de vitalidad y deepfakes para verificar la identidad con un alto grado de seguridad.

Lo hacen manteniendo el proceso fácil de usar y escalable, un factor importante para la incorporación de tecnología financiera o los grandes programas de identificación gubernamentales en los que se puede verificar de forma remota a millones de usuarios. En resumen, la lucha contra los ataques deepfake a la verificación biométrica requiere una combinación de tecnología de vanguardia y políticas prudentes. En el aspecto tecnológico, la verificación multifactorial y mejorada con IA, la biometría facial combinada con un sólido control de vitalidad y detección de deepfakes, se ha convertido en el estándar de referencia para defenderse de los impostores generados por IA. En el aspecto normativo, las organizaciones deben mantenerse al día de las directrices en constante evolución (de organismos como el NIST y la ISO) y fomentar una cultura consciente de la seguridad.

La carrera armamentística entre los creadores de deepfakes y los defensores de la biometría está en marcha y es probable que se intensifique. Sin embargo, con un enfoque proactivo y por capas, las instituciones pueden preservar la confianza digital y autenticar con seguridad a sus usuarios, incluso cuando la IA generativa transforma el panorama de las amenazas. El mensaje para los líderes es claro: el fraude con deepfakes ya no es un problema del futuro, sino del presente, e invertir ahora en las defensas adecuadas es fundamental para adelantarse a los ciberdelincuentes y mantener la integridad de los sistemas de identificación biométrica.

Obtenga una demostración personalizada de nuestra plataforma biométrica sin contacto y compruebe cómo se adapta a su caso de uso específico.

Bibliografía

Actualización biométrica, «Google permite el uso de datos biométricos para la detección de similitudes en YouTube en el entrenamiento de IA» (Joel R. McConvey, diciembre de 2025).

Alerta de la FinCEN, «Estafas relacionadas con deepfakes e inteligencia artificial generativa» (FIN-2024-Alert004, noviembre de 2024).

Alerta FinCEN, FIN-2024-Alert004, 13 de noviembre de 2024. https://www.fincen.gov/system/files/shared/FinCEN-Alert-DeepFakes-Alert508FINAL.pdf