Índice

ToggleEn los últimos años, la inteligencia artificial se ha convertido en una de las tecnologías más reconocidas y utilizadas, no solo por los usuarios finales, sino también por empresas de todo el mundo. Su capacidad para resolver rápidamente problemas complejos y automatizar tareas ha situado a esta tecnología en el punto de mira, hasta tal punto que consultoras como McKinsey, en su informe «State of AI in 2025», ya señalan que el 88 % de las empresas utilizan la Inteligencia Artificial en al menos una de las funciones de su negocio.

Sin embargo, el avance imparable de esta tecnología también ha atraído la atención de los ciberdelincuentes, quienes han encontrado en ella una forma de llevar a cabo intentos cada vez más sofisticados y complejos de suplantación de identidad y robo de identidad, lo que tiene un impacto económico significativo en sus víctimas, pero también en las entidades públicas y privadas. De hecho, las previsiones de Deloitte indican que el fraude causado por la inteligencia artificial tendrá un impacto de más de 40 000 millones de dólares en todo el mundo para 2027, una cifra que pone de manifiesto su importancia para la economía global.

Desde el fraude mediante el uso de máscaras y fotos hasta los deepfakes

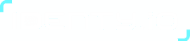

¿Cómo se utiliza la IA para cometer estos fraudes y robos de identidad? Hasta ahora, los delincuentes han recurrido a lo que se conoce como «ataques de presentación», en los que utilizan una fotografía impresa en alta definición, un molde de silicona para replicar la huella dactilar de la víctima con gran precisión o, simplemente, una máscara para intentar burlar los filtros de seguridad. Sin embargo, la llegada de la IA también ha propiciado la aparición de los denominados «deepfakes», falsificaciones biométricas generadas digitalmente que emulan rasgos faciales o voces con gran realismo.

Las redes neuronales profundas se utilizan para crear estos dobles digitales con el objetivo de eludir cualquier medida de protección. Según el informe «Human Detection of Deepfakes: An Investigation of Confidence and Accuracy», el ojo humano solo es capaz de detectar el 24,5 % de los deepfakes, lo que significa que siete de cada diez pasan desapercibidos. Ni siquiera los procesos en los que la verificación de identidad se lleva a cabo mediante videollamadas son seguros, debido a la capacidad de la IA para inyectar estos deepfakes en transmisiones de vídeo en tiempo real, por ejemplo.

La tecnología ha alcanzado tal nivel de sofisticación que las imágenes generadas por ella son capaces de parpadear o realizar movimientos predefinidos, de modo que ni siquiera la detección por parte de los sistemas de verificación de vida —es decir, los sistemas que utilizan muchas entidades en su proceso de registro para comprobar que el usuario es real pidiéndole que mueva la cabeza en una dirección determinada o que parpadee de una forma concreta— ofrece garantías suficientes. Y las consecuencias podrían tener un impacto de gran alcance, permitiendo la apertura de cuentas bancarias fraudulentas, transacciones no autorizadas, retiradas de fondos de jubilación o la obtención de tratamientos médicos que pertenecen a otro usuario.

Un ejemplo muy sonado: a principios de 2024, una empleada del departamento financiero de una empresa con sede en Hong Kong fue engañada mediante una videollamada deepfake en la que se suplantaba la identidad de su jefe de finanzas y de varios compañeros, lo que la llevó a autorizar una transferencia de 25 millones de dólares estadounidenses a los estafadores. Los ejemplos del mundo real fundamentan la amenaza en un incidente concreto y verificable. El fraude deepfake de Hong Kong (5 de mayo de 2024) fue ampliamente cubierto por Reuters, la BBC y la prensa financiera. Los casos concretos causan mayor impacto en el público del sector bancario que las descripciones abstractas.

La IA como parte de la solución al problema de los deepfakes y el robo de identidad

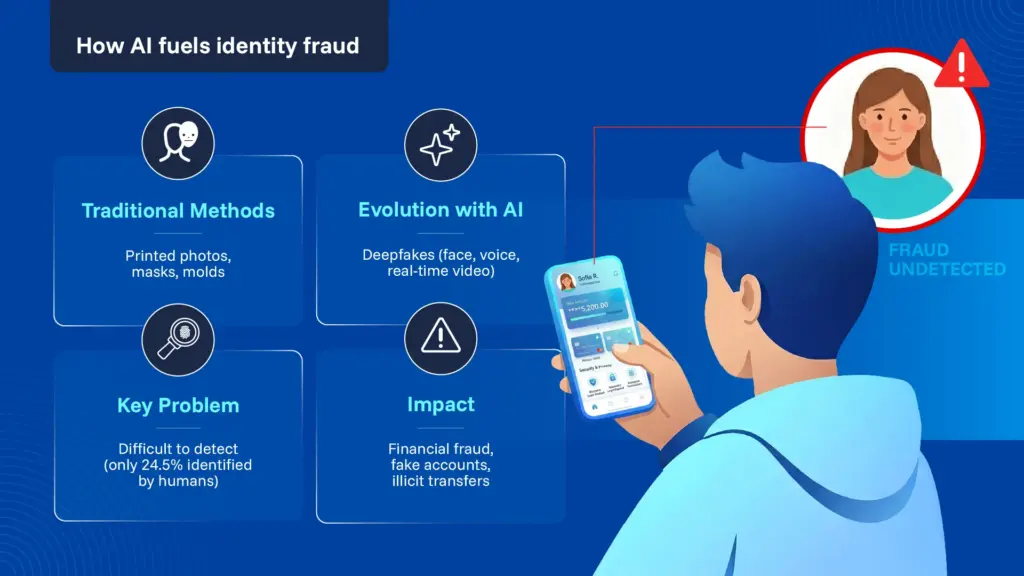

Si bien la tecnología utilizada por los delincuentes ha evolucionado rápidamente, también lo ha hecho la tecnología empleada por entidades como Identy.io para prevenir el robo y la suplantación de identidad. Uno de los aspectos más importantes en este sentido es la detección pasiva de vida, una solución diseñada específicamente para detectar casos en los que un tercero intenta burlar los sistemas de seguridad implementados por una entidad pública o privada y utilizar este fraude de identidad con fines ilícitos.

¿Cómo funciona la detección pasiva de vida? Esta tecnología no requiere que el usuario interactúe directamente con el sistema. En otras palabras, no necesita que el usuario realice movimientos predefinidos por el sistema para distinguir entre un usuario real y un doble digital. La variante pasiva se ejecuta en segundo plano, intentando detectar signos de vida en un fotograma único o en una secuencia de vídeo, utilizando modelos de IA entrenados para detectar matices en la textura de la piel, la iluminación, los micromovimientos faciales o las respuestas naturales del usuario.

Entonces, ¿es necesario prescindir de los sistemas que utilizan las huellas dactilares como única medida de seguridad? No. La verdad es que la biometría de huellas dactilares se reconoce como una forma fiable de autenticación, aunque con la evolución de la tecnología es cada vez más habitual encontrar formas de autenticación multimodales o multifactoriales, en las que las pruebas pasivas de vida mediante rasgos faciales se convierten en una capa adicional de seguridad contra el fraude. Esto es especialmente cierto si se tiene en cuenta que muchos sensores de huellas dactilares modernos ya incorporan sus propias pruebas de vida, detectando, por ejemplo, el sudor en la piel o el pulso.

La tecnología desarrollada por Identy.io, además de incorporar los últimos avances en detección pasiva de vida, tiene la ventaja de procesar toda la información personal y biométrica del usuario directamente en su dispositivo móvil, lo que evita la necesidad de costosos escáneres biométricos y los desplazamientos hasta los centros donde se encuentran. Con solo un teléfono móvil equipado con una sencilla cámara y flash, el sistema es capaz de detectar las huellas dactilares o el rostro del usuario, realizar las comprobaciones pasivas de signos vitales necesarias y almacenar la información personal del usuario en el mismo teléfono móvil, bajo los más altos estándares de encriptación, completamente a salvo de posibles ataques o robos de identidad.

La detección pasiva de vida de Identy.io ha obtenido una certificación independiente conforme a la norma NIST ISO 30107-3 de nivel 2 —la norma de detección de ataques de presentación más rigurosa del sector— con una puntuación perfecta. Esta certificación resulta especialmente relevante para las entidades bancarias y de tecnología financiera, que deben demostrar el cumplimiento de normativas KYC y AML cada vez más estrictas, así como para los operadores de telecomunicaciones, que se enfrentan al fraude por suplantación de tarjetas SIM y a la verificación de la identidad de los abonados en el proceso de alta.

Como podemos ver, en un momento en el que la inteligencia artificial se ha convertido en una amenaza en constante evolución, esa misma tecnología se convierte también en una garantía de que los datos personales del usuario estarán debidamente protegidos y a salvo del uso de deepfakes o dobles digitales.