Índice

AlternarNos últimos anos, a Inteligência Artificial tornou-se uma das tecnologias mais reconhecidas e amplamente utilizadas, não apenas pelos usuários finais, mas também por empresas em todo o mundo. Sua capacidade de resolver rapidamente problemas complexos e automatizar tarefas colocou essa tecnologia em destaque, a tal ponto que empresas de consultoria como a McKinsey, em seu relatório “State of AI in 2025”, já apontam que 88% das empresas utilizam a Inteligência Artificial em pelo menos uma função de seus negócios.

No entanto, o avanço imparável dessa tecnologia também atraiu a atenção dos cibercriminosos, que encontraram nela uma forma de realizar tentativas cada vez mais sofisticadas e complexas de suplantar a identidade e roubar dados pessoais, o que tem um impacto econômico significativo sobre suas vítimas, mas também sobre entidades públicas e privadas. De fato, as projeções da Deloitte indicam que a fraude causada pela inteligência artificial terá um impacto de mais de US$ 40 bilhões em todo o mundo até 2027, um número que revela sua importância para a economia global.

Desde fraudes com máscaras e fotos até deepfakes

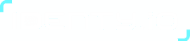

Como a IA é usada para cometer essas fraudes e roubos de identidade? Até agora, os criminosos utilizavam os chamados ataques de apresentação, nos quais usavam uma fotografia impressa em alta definição, um molde de silicone para replicar a impressão digital da vítima com grande precisão ou simplesmente uma máscara para tentar contornar os filtros de segurança. No entanto, o surgimento da IA também levou ao aparecimento dos chamados deepfakes, falsificações biométricas geradas digitalmente que imitam traços faciais ou vozes com grande realismo.

As redes neurais profundas são utilizadas para criar esses sósias digitais com o objetivo de contornar quaisquer medidas de proteção. De acordo com o relatório “Human Detection of Deepfakes: An Investigation of Confidence and Accuracy” (Detecção humana de deepfakes: uma investigação sobre confiança e precisão), o olho humano é capaz de detectar apenas 24,5% dos deepfakes, o que significa que sete em cada dez passam despercebidos. Nem mesmo os processos em que a verificação de identidade é realizada por meio de videochamadas estão seguros, devido à capacidade da IA de inserir esses deepfakes em transmissões de vídeo em tempo real, por exemplo.

A tecnologia tornou-se tão sofisticada que as imagens geradas por ela são capazes de piscar ou realizar movimentos predefinidos, de modo que mesmo a detecção por sistemas de verificação de autenticidade — ou seja, sistemas utilizados por muitas entidades em seus processos de cadastro para verificar se o usuário é real, solicitando que ele mova a cabeça em uma determinada direção ou pisque de uma maneira específica — não oferece garantias absolutas. E as consequências podem ter um impacto de longo alcance, permitindo a abertura de contas bancárias fraudulentas, transações não autorizadas, saques de fundos de aposentadoria ou a obtenção de tratamentos médicos que pertencem a outro usuário.

Um exemplo de grande repercussão: no início de 2024, uma funcionária do departamento financeiro de uma empresa sediada em Hong Kong foi enganada por uma videochamada com deepfake que se fazia passar pelo chefe do departamento financeiro e por vários colegas, levando-a a autorizar uma transferência de US$ 25 milhões para os fraudadores. Exemplos do mundo real fundamentam a ameaça em um incidente concreto e verificável. A fraude com deepfake em Hong Kong (5M, janeiro de 2024) foi amplamente divulgada pela Reuters, pela BBC e pela imprensa financeira. Casos concretos causam mais impacto no público do setor bancário do que descrições abstratas.

A IA como parte da solução para deepfakes e roubo de identidade

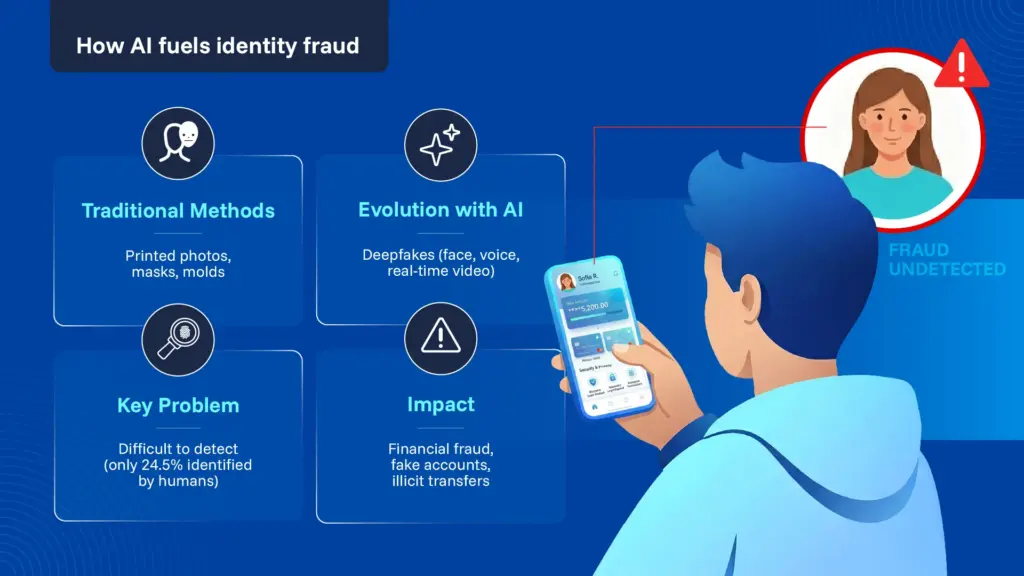

Embora a tecnologia utilizada pelos criminosos tenha evoluído rapidamente, o mesmo ocorreu com a tecnologia empregada por entidades como a Identy.io para prevenir roubos e fraudes de identidade. Um dos aspectos mais importantes nesse sentido é a detecção passiva de vitalidade, uma solução projetada especificamente para identificar casos em que terceiros tentam violar os sistemas de segurança implementados por uma entidade pública ou privada e utilizar essa fraude de identidade para fins ilícitos.

Como funciona o teste passivo de detecção de presença? Essa tecnologia não exige que o usuário interaja diretamente com o sistema. Em outras palavras, não é necessário que o usuário execute movimentos predefinidos pelo sistema para distinguir entre um usuário real e um sósia digital. A variante passiva é executada em segundo plano, tentando detectar sinais de vida em um único quadro ou sequência de vídeo, utilizando modelos de IA treinados para detectar nuances na textura da pele, iluminação, micromovimentos faciais ou respostas naturais do usuário.

Então, é necessário abandonar os sistemas que utilizam impressões digitais como única medida de segurança? Não. A verdade é que a biometria de impressões digitais é reconhecida como uma forma confiável de autenticação, embora, com a evolução da tecnologia, seja cada vez mais comum encontrar formas multimodais ou multifatoriais de autenticação, nas quais testes passivos de verificação de vida, utilizando características faciais, tornam-se uma camada adicional de segurança contra fraudes. Isso é especialmente verdadeiro considerando que muitos sensores modernos de impressões digitais já incorporam seus próprios testes de verificação de vida, detectando suor na pele ou pulso, por exemplo.

A tecnologia desenvolvida pela Identy.io, além de incorporar os mais recentes avanços em detecção passiva de vida, tem a vantagem de processar todas as informações pessoais e biométricas do usuário diretamente em seu dispositivo móvel, evitando assim a necessidade de scanners biométricos caros e deslocamentos até os locais onde eles se encontram. Com apenas um celular equipado com uma câmera simples e flash, o sistema é capaz de detectar as impressões digitais ou o rosto do usuário, realizar as verificações passivas de sinais de vida necessárias e armazenar as informações pessoais do usuário no mesmo celular, sob os mais altos padrões de criptografia, totalmente a salvo de possíveis ataques ou roubo de identidade.

A detecção passiva de presença da Identy.io foi certificada de forma independente de acordo com a norma NIST ISO 30107-3 Nível 2 — a norma de detecção de ataques de apresentação mais rigorosa do setor —, obtendo nota máxima. Essa certificação é particularmente relevante para instituições bancárias e de fintech, que precisam demonstrar conformidade com regulamentações cada vez mais rigorosas de KYC e AML, bem como para operadoras de telecomunicações que enfrentam fraudes de troca de SIM e precisam verificar a identidade dos assinantes durante o processo de cadastro.

Como podemos ver, numa época em que a inteligência artificial se tornou uma ameaça em constante evolução, essa mesma tecnologia também se torna uma garantia de que os dados pessoais do usuário serão devidamente protegidos e estarão a salvo do uso de deepfakes ou sósias digitais.