Índice

AlternarO que é um deepfake biométrico?

Um deepfake biométrico é uma falsificação gerada por IA que imita os dados biométricos de uma pessoa (normalmente imagens faciais ou voz), muitas vezes com um realismo surpreendente. Usando redes neurais profundas, os invasores podem criar rostos ou vídeos sintéticos que imitam de perto a aparência e as expressões de um usuário real. Essas falsificações representam uma séria ameaça aos sistemas de reconhecimento facial e aos processos de verificação de identidade. Os olhos humanos e até mesmo algoritmos padrão têm dificuldade em distinguir deepfakes de alta qualidade de imagens genuínas. Em um estudo, as pessoas só identificaram vídeos deepfake em 24,5% das vezes.

Isso significa que 75% dos deepfakes passaram despercebidos, o que mostra como eles podem passar facilmente por defesas simples. Impacto no reconhecimento facial e na detecção de vida: o reconhecimento facial tradicional compara uma selfie com uma foto de identidade, assumindo que a selfie é real. Os deepfakes acabam com isso, apresentando uma imagem ou vídeo ao vivo manipulado por IA do rosto de alguém. Ao contrário das falsificações tradicionais (por exemplo, uma foto impressa ou máscara), os deepfakes são dinâmicos , o rosto falso pode piscar, se mover e até mesmo responder a comandos, enganando a detecção básica de vivacidade. Os algoritmos de vivacidade são projetados para garantir que um rosto seja capturado de uma pessoa viva (não uma imagem estática ou reprodução), geralmente verificando movimentos naturais ou profundidade 3D. No entanto, as gerações anteriores de verificações de vivacidade (como pedir aos usuários para piscar ou virar a cabeça) são facilmente enganadas pela tecnologia deepfake atual.

Por exemplo, a IA agora pode gerar um vídeo de um rosto que pisca e se move sob comando. Se um fraudador alimentar um vídeo deepfake por meio de um aplicativo de câmera virtual em um sistema de verificação, uma verificação biométrica despreparada pode aceitá-lo como “ao vivo”. Isso coloca o onboarding digital e a comprovação de identidade remota em sério risco. Provedores de fintech, bancos e até mesmo portais governamentais que dependem da verificação baseada em selfies perceberam que ataques deepfake podem passar despercebidos, se passando por vítimas, apesar da segurança em várias camadas.

O resultado pode ser a abertura de contas fraudulentas, transações não autorizadas ou identidades falsas passando pelos verificações de Know-Your-Customer (KYC) e antilavagem de dinheiro (AML).

Os deepfakes estão se tornando cada vez mais sofisticados, aumentando o risco de fraudes e manipulação de identidade em ambientes digitais. Baixe nosso guia de 10 etapas para aprender como detectar ameaças antecipadamente e proteger sua organização com práticas recomendadas comprovadas.

Deepfake: Da falsificação tradicional aos ataques impulsionados por IA

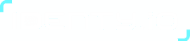

Falsificação biométrica vs. ataques baseados em deepfake: No passado, a principal preocupação eram os ataques de apresentação usando adereços físicos ou mídias gravadas. Os fraudadores podiam mostrar a foto de uma pessoa para a câmera, usar uma máscara realista ou reproduzir um vídeo da vítima. A detecção de vivacidade foi introduzida para derrotar esses truques, por exemplo, detectando imagens planas ou exigindo movimentos interativos. Os deepfakes, no entanto, aumentam a dificuldade.

Não se trata apenas de gravações roubadas, mas de mídia sintética gerada por IA, muitas vezes capaz de imitar movimentos faciais e comportamentos sutis. Um deepfake bem elaborado pode parecer mais convincente do que uma foto estática e, sem verificações avançadas, pode passar despercebido por sistemas que procuram apenas sinais simples de vida. Em essência, os deepfakes são uma extensão sofisticada da falsificação biométrica: em vez de uma falsificação grosseira (como uma foto impressa), o invasor apresenta uma persona “ao vivo” falsificada. Isso forçou uma mudança nas estratégias de segurança. As soluções padrão de soluções padrão de reconhecimento facial por si só não conseguem distinguir de forma confiável um rosto real de um impostor gerado por IA. Mesmo muitos sistemas de verificação de vida que não estão atualizados não conseguem detectar deepfakes de alta qualidade ou máscaras 3D. O setor está aprendendo que a autenticação biométrica tradicional é vulnerável a falsificações impulsionadas por IA. Para resolver isso, as equipes de segurança estão recorrendo a defesas duplas: autenticação biométrica + detecção de deepfakes em conjunto.

Falsificação tradicional versus deepfake biométrico

Por que a detecção de vida não é suficiente (por si só)

A detecção de presença humana continua sendo vital, pois verifica se há uma pessoa viva na frente da câmera, e não apenas um artefato. As técnicas variam de solicitações ativas (piscadela, sorriso, virar a cabeça) a análises passivas (aprendizado de máquina analisando a textura da pele, reflexos e profundidade 3D a partir de um vídeo curto). A detecção de vida real pode detectar muitas apresentações falsas. Por exemplo, sistemas 3D certificados de detecção de vida real podem detectar que um vídeo deepfake é, na verdade, uma projeção 2D com iluminação estranha, pois uma tela emite luz de maneira diferente do que um rosto real reflete, o que um bom sistema irá sinalizar.

No entanto, a detecção de vivacidade por si só pode não detectar todas as falsificações geradas por IA, especialmente à medida que os deepfakes melhoram. É por isso que os especialistas agora enfatizam a combinação da detecção de vivacidade com algoritmos de detecção de deepfakes. As duas abordagens se complementam: a detecção de vivacidade confirma que há uma tentativa humana real, enquanto a detecção de deepfakes analisa se o próprio rosto “humano” pode ter sido gerado ou manipulado por computador. A importância de combinar abordagens: as ferramentas de detecção de deepfakes usam IA para examinar entradas visuais e de áudio em busca de sinais reveladores de adulteração, como movimentos faciais não naturais, sincronização labial inconsistente, distorções na imagem ou falhas na textura e na iluminação. Essas são pistas de que um rosto pode ter sido alterado sinteticamente. Ao sobrepor essa análise às verificações de vivacidade, uma plataforma pode verificar tanto a presença (humano vivo vs. artefato) quanto a autenticidade (pessoa real vs. deepfake).

Em ambientes de alta segurança, como o setor bancário, plataformas de segurança biométrica com proteção contra deepfakes tornaram-se essenciais. Os líderes do setor prevêem que a detecção de deepfakes passará de uma novidade para uma “higiene de segurança” padrão nos próximos anos. Na verdade, os reguladores já estão caminhando nessa direção. As mais recentes diretrizes de identidade digital do NIST dos EUA incluem explicitamente requisitos para defesa contra deepfakes e outros ataques gerados por IA. Da mesma forma, laboratórios terceirizados agora testam os fornecedores quanto à resistência a “ataques de injeção” (ou seja, resiliência a vídeos deepfake injetados ou imagens sintéticas) como parte da certificação do sistema biométrico. Tudo isso ressalta que uma única camada de defesa não é mais suficiente. Somente uma abordagem em várias camadas , verificação de documentos, correspondência facial, verificação de vida e detecção de deepfakes juntas, podem impedir de forma confiável a fraude de identidade impulsionada pela IA.

Saiba como a Identy.io reforçou a segurança móvel no setor bancário com biometria avançada por impressão digital e uma experiência de usuário perfeita.

Ameaças à Fintech, ao setor bancário e à integração governamental

A integração digital em serviços financeiros e governamentais aumentou significativamente, assim como as tentativas de fraude de identidade com deepfakes. Bancos e credores online, por exemplo, utilizam biometria de selfies para verificar novos clientes rapidamente. No entanto, os criminosos estão explorando essa conveniência. Testes biométricos deepfake no mundo real revelaram vulnerabilidades alarmantes. Em um caso, uma instituição financeira indonésia descobriu mais de 1.100 tentativas de deepfake para contornar sua integração remota em 2024. Os fraudadores obtiveram dados de identidade roubados e, em seguida, usaram IA para gerar novas selfies correspondentes às identidades, efetivamente se passando pelas vítimas. Esses deepfakes enganaram o reconhecimento facial e as verificações básicas de vitalidade do banco, permitindo que pedidos de empréstimo falsos fossem aprovados. O esquema só foi descoberto após uma análise avançada, mas destacou um potencial prejuízo de mais de US$ 138 milhões se essas contas tivessem sido totalmente exploradas. Este exemplo ilustra como um deepfake que contorna o KYC não é uma preocupação teórica , mas algo que está acontecendo agora, em grande escala, nos mercados de fintech.

Os órgãos governamentais e reguladores estão atentos a isso. Nos Estados Unidos, a Rede de Combate a Crimes Financeiros (FinCEN) do Tesouro emitiu um alerta no final de 2024 sobre esquemas de fraude usando deepfakes. A FinCEN alertou que agentes mal-intencionados podem usar identidades sintéticas e até mesmo vídeos deepfake em tempo real para burlar as verificações ao vivo durante a identificação do cliente. Em um esquema notável, os requerentes tentaram abrir contas bancárias com fotos de passaporte geradas por IA e alegaram problemas técnicos durante as verificações por vídeo ao vivo para encobrir as falhas do deepfake. Tais incidentes levantam bandeiras vermelhas para a conformidade AML: se os bancos não puderem verificar identidades reais de forma confiável, os criminosos poderão criar contas para lavar dinheiro ou fraudar sistemas. Além do setor bancário, órgãos governamentais que prestam serviços digitais (de portais fiscais a inscrições para benefícios sociais) enfrentam riscos semelhantes. Um deepfake pode permitir que alguém roube uma identidade e acessar os registros ou direitos de outra pessoa, prejudicando a integridade dos programas de governo eletrônico.

O exemplo da ferramenta deepfake do YouTube: mesmo as plataformas tecnológicas convencionais estão enfrentando essa ameaça. Recentemente, o YouTube lançou uma ferramenta de verificação biométrica para criadores detectarem e removerem vídeos manipulados por IA que utilizam indevidamente sua imagem. Essa medida foi notícia como uma faca de dois gumes: é uma resposta ao abuso do deepfake, mas levantou preocupações, já que a política do YouTube permite tecnicamente que os dados biométricos coletados (digitalizações faciais dos criadores) sejam usados para treinamento de IA. Para os líderes de fintech e do governo, a conclusão é clara: se um gigante como o YouTube se sente compelido a lançar um mecanismo de detecção de deepfake, a ameaça é generalizada. E se manchetes sobre a “ferramenta de verificação biométrica deepfake do YouTube” estão aparecendo nas notícias, isso significa que os riscos do deepfake entraram na consciência pública. Infelizmente, as mesmas ferramentas acessíveis que permitem aos criadores combater os deepfakes podem ser reaproveitadas por fraudadores. A internet está repleta de tutoriais sobre como criar deepfakes convincentes; no próprio YouTube, há guias detalhados para gerar trocas de rosto usando softwares como o DeepFaceLab. Essa democratização da tecnologia deepfake significa que mesmo invasores relativamente pouco qualificados podem tentar fraudes de identidade baseadas em deepfakes. As fintechs e os bancos devem presumir que uma porcentagem de suas tentativas de cadastro será composta por falsificações assistidas por IA e se preparar adequadamente.

Melhores práticas contra deepfake

Melhores práticas para detecção biométrica de deepfakes em segurança Fintech

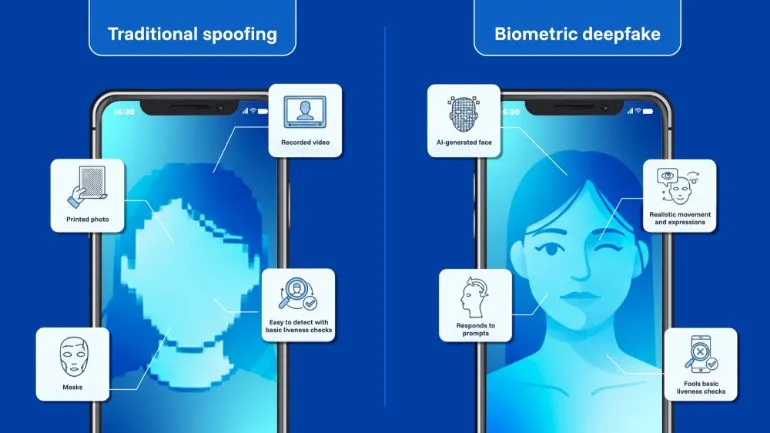

Para manter a confiança digital e cumprir as obrigações de conformidade, as organizações financeiras e governamentais estão adotando as melhores práticas para combater as ameaças de deepfake. Aqui estão as principais estratégias que as plataformas modernas de segurança biométrica empregam para proteção contra deepfake:

Comprovação de identidade em várias camadas

Plataformas robustas combinam autenticação de documentos, correspondência biométrica e detecção de falsificação em um único fluxo. Por exemplo, um sistema avançado de integração irá escanear a identidade do usuário em busca de sinais de adulteração, comparar o rosto na identidade com uma selfie ao vivo e executar a detecção de autenticidade e deepfake nessa selfie. Várias verificações criam proteções sobrepostas, mesmo que um deepfake passe por uma camada, outra pode detectá-lo. Essa abordagem em camadas está alinhada com as orientações dos reguladores para usar verificação multifatorial baseada em risco (por exemplo, algumas jurisdições agora exigem uma combinação de identidade com foto, verificação biométrica com verificação de vida e até mesmo análise de metadados de telefone ou IP para casos de alto risco).

Vitalidade passiva para uma melhor experiência do usuário

A experiência do usuário continua sendo uma prioridade, pois muito atrito pode afastar clientes legítimos. As soluções mais recentes enfatizam a detecção passiva de vida, que funciona em segundo plano sem exigir que os usuários realizem movimentos estranhos. A IA analisa o feed de vídeo em busca de sinais de autenticidade (como textura, padrões moiré, profundidade 3D) em uma fração de segundo, normalmente quando o usuário simplesmente olha para a câmera. Essa abordagem de segurança passiva, usada por plataformas como a Identy, mantém o processo de verificação contínuo, ao mesmo tempo em que garante que a pessoa seja real. Quando a detecção passiva de vida é combinada com a verificação de deepfakes, a segurança fica “invisível” para usuários honestos, que concluem o cadastro em segundos, mas as tentativas de falsificação são discretamente sinalizadas para revisão ou rejeição. Alcançar esse equilíbrio entre segurança e conveniência é crucial para a adoção da fintech, onde as taxas de desistência podem prejudicar os negócios. Uma solução estratégica irá, portanto, “confiar, mas verificar” silenciosamente cada tentativa de cadastro, só escalando quando algo parecer suspeito.

Monitoramento contínuo e análise de IA

As verificações biométricas não devem parar após a abertura da conta. Equipes de segurança com visão de futuro implementam um monitoramento contínuo de fraudes que pode detectar o uso de deepfakes mesmo após a integração. Isso pode incluir inteligência de dispositivos (para detectar o uso de emuladores ou câmeras virtuais), análise comportamental e monitoramento de transações vinculado à reautenticação biométrica para ações de alto risco. Por exemplo, se uma conta iniciar repentinamente uma grande transferência por meio de uma transação autorizada por vídeo, o sistema pode solicitar uma nova verificação de vida + rosto e procurar sinais de deepfake antes da aprovação. As plataformas modernas geralmente integram essas verificações a bancos de dados de fraudes. Se um determinado rosto ou dispositivo estiver associado a uma tentativa conhecida de fraude deepfake em outro lugar, ele pode ser automaticamente colocado na lista negra ou sujeito a uma verificação aprimorada. A colaboração por meio do compartilhamento de inteligência antifraude está se tornando uma prática recomendada, de modo que, quando um banco detecta um invasor deepfake, outros são alertados para ficarem atentos aos mesmos sinais.

Testes regulares de resiliência contra deepfakes

Dada a rapidez com que a tecnologia deepfake evolui, os bancos e fornecedores devem avaliar regularmente seus sistemas em relação às novas técnicas de ataque. Isso inclui a realização de testes biométricos deepfake em ambientes controlados, essencialmente simulando o sistema com rostos e vozes falsos gerados para ver se algum deles passa despercebido. Algumas instituições fazem parceria com empresas de segurança ou participam de testes do setor (por exemplo, os laboratórios iBeta e avaliadores independentes agora testam sistemas biométricos quanto à resistência a vídeos deepfake como parte da certificação). Ao testar e ajustar proativamente, as organizações podem corrigir vulnerabilidades antes que os criminosos as descubram. Além disso, manter-se atualizado com os padrões mais recentes (como ISO/IEC 30107 para detecção de ataques de apresentação biométrica e suas extensões mais recentes que abordam ataques de IA) garante que a plataforma atenda aos mais altos padrões de segurança.

Formação de usuários e funcionários

Por fim, uma medida suave, mas importante, é aumentar a conscientização sobre deepfakes. A equipe de conformidade da linha de frente deve ser treinada para identificar sinais de uso potencial de deepfakes em revisões manuais (por exemplo, se o vídeo de um candidato tiver movimentos oculares não naturais ou se o vídeo de um entrevistado estiver estranhamente fora de sincronia com o áudio). Os clientes também podem ser instruídos sobre como verificar as comunicações. Por exemplo, um banco pode avisar que nunca solicitará determinadas ações por meio de uma videochamada, para que o cliente possa questionar uma situação em que um “funcionário do banco” no vídeo pareça real, mas esteja pressionando por uma transação incomum (uma situação que já ocorreu com deepfakes de fraude de CEO). Construir uma cultura de “ceticismo digital” em torno de solicitações biométricas inesperadas pode adicionar uma camada extra de defesa contra a engenharia social que emprega deepfakes.

Protegendo a identidade digital na era do deepfake

Os deepfakes representam uma ameaça emergente à segurança digital, especialmente em setores de alta confiança, como finanças e governo. Para os CMOs, essa ameaça se traduz em uma potencial erosão da confiança do cliente. Se os usuários forem vítimas de fraude devido a um deepfake, a reputação da marca em termos de segurança pode despencar. Para os diretores de tecnologia e chefes de segurança, os deepfakes são um chamado à ação para reforçar os sistemas agora, em vez de mais tarde, porque o custo da inação é medido em perdas por fraude, multas por não conformidade e danos à confiança do público. A solução estratégica é investir em plataformas avançadas de segurança biométrica que oferecem proteção contra deepfakes por padrão. Plataformas como a Identy exemplificam essa abordagem, combinando a detecção biométrica de vida e deepfake para verificar a identidade com um alto grau de segurança.

Eles fazem isso mantendo o processo fácil de usar e escalável, um fator importante para a integração de fintech ou grandes programas de identificação governamentais, nos quais milhões de usuários podem ser verificados remotamente. Em resumo, combater ataques deepfake à verificação biométrica requer uma combinação de tecnologia de ponta e políticas prudentes. No lado da tecnologia, a verificação multifatorial e aprimorada por IA, biometria facial combinada com robusta verificação de vida e triagem de deepfakes, tornou-se o padrão ouro para a defesa contra impostores gerados por IA. No lado das políticas, as organizações devem se manter a par das diretrizes em evolução (de órgãos como NIST e ISO) e promover uma cultura consciente da segurança.

A corrida armamentista entre criadores de deepfakes e defensores da biometria está em andamento e provavelmente se intensificará. Mas, com uma abordagem proativa e em camadas, as instituições podem preservar a confiança digital e autenticar seus usuários com segurança, mesmo com a IA generativa transformando o cenário de ameaças. A mensagem para a liderança é clara: a fraude deepfake não é mais um problema do futuro, ela está aqui hoje, e investir nas defesas certas agora é fundamental para ficar um passo à frente dos cibercriminosos e manter a integridade dos sistemas de identificação biométrica.

Obtenha uma demonstração personalizada da nossa plataforma biométrica sem contato e veja como ela se adapta ao seu caso de uso específico.

Bibliografia

Atualização biométrica, “Google permite que a biometria para detecção de semelhanças no YouTube seja usada no treinamento de IA” (Joel R. McConvey, dezembro de 2025).

Alerta da FinCEN, “Esquemas fraudulentos envolvendo deepfakes e IA generativa” (FIN-2024-Alert004, novembro de 2024).

Alerta FinCEN, FIN-2024-Alert004, 13 de novembro de 2024. https://www.fincen.gov/system/files/shared/FinCEN-Alert-DeepFakes-Alert508FINAL.pdf